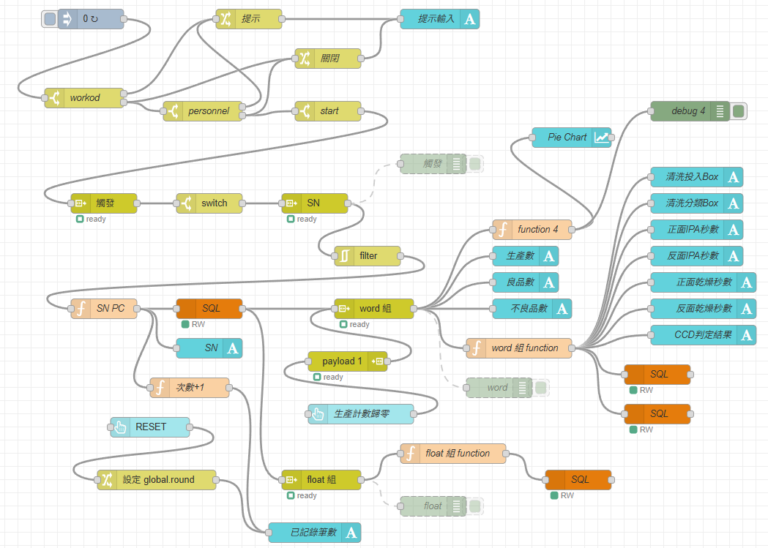

為什麼明明選了高畫素相機,機械手臂的重複定位精度還是不如預期?在機器視覺的世界裡,硬體規格只是門檻,真正的精度取決於你對「物理天花板」與「數學靈魂」的理解。

本文將帶你深度拆解工業視覺系統的核心要素:

從相機解析度如何定義手臂移動的「最小刻度」開始,探討為什麼視覺量測必須捨棄一般鏡頭、改採體積龐大的「遠心鏡頭」來消除透視誤差。我們也將揭開「光源藝術」如何決定邊緣偵測的成敗,並剖析業界常見的「次像素 (Sub-pixel)」技術,教你如何透過數學算法突破物理像素的限制,讓精度有感提升 3 到 10 倍。這篇實戰心得將幫助你建立穩健的視覺選型邏輯,避開那些「鏡頭塞不下」或「精度對不準」的昂貴坑洞。

物理刻度的起點:相機解析度如何決定機械手臂的「最小步長」?

霓可

說到天花板,很多人以為只要砸錢買最高階的相機就能解決問題,但物理規則是不會因為預算就轉彎的喔。就像我想設計出世界最強的機器人,也得先從搞懂這些像素顆粒開始…啊,我只是隨便舉個例子,你別誤會,我才沒有每天關在房間裡畫設計圖呢。

相機要定位準確首先要決定機器視覺系統的精密程度,如果就單純物理的角度來看的條件有:

- 相機的解析度

- 鏡頭的成像

- 主動與環境光源

相機的解析度可以直覺的聯想到拍攝後的成像精細程度,例如 31 萬畫素的相機水平、垂直畫素等於 640 x 480,再視野寬 50mm 的情況下每顆像素的尺寸就是 0.078mm;而 192 萬畫素水平、垂直畫素等於 1600 x 1200 的相機,在相同視野下每顆像素的尺寸則會達到 0.031mm,因此從單位像素的尺寸來說,解析度越高的相機就能在同個視野內塞入越多的像素,並且每個像素的尺寸也越小,因此也可以理解成「越高的解析度能用越多的向素來描述物體的邊緣與形狀」。

其次,相機的解析度在機器視覺定位的系統上,基礎的提供了機械手臂收到視覺系統座標的”最小刻度“,假設一個視覺系統每顆像素的尺寸是 0.078mm,在沒有軟體干預的情況下機器視覺提供的最小刻度就會是 0.078mm,這裡也可以很好的想像「過低的相機解析度,會讓機械手臂移動的最小移動跨步很大,不容易走到想要的精確位置。」

工業相機解析度模擬

切換不同工業相機規格,觀察在「AOI 局部放大檢測」下的細節差異。

選擇相機規格

物理換算數據 (FOV 50mm)

我們正在檢視其中 8mm 的局部

這張圖模擬了 AOI 設備在進行「次像素級檢測」時的視野。

- 0.3 MP:像素大達 0.078mm,僅適合判斷物體有無或讀取大型條碼。

- 20 MP:精度達到 0.009mm,能檢測出極細微的刮痕或進行高精密量測。

拒絕視覺騙局:為什麼視覺量測與定位非「遠心鏡頭」不可?

再來提到鏡頭成像,鏡頭與相機兩者必須相輔相成,鏡頭不只是放大縮小倍率的透鏡,而是因為光學的設計會有適合的解析度和視野大小,除此之外在機器視覺定位這類需要量測的需求上,相機鏡頭還會更偏好使用"遠心鏡頭"來解決透視的問題,透視問題可以想像一根長長的空心圓管,透過肉眼觀察內孔會發現越近的孔看起來越大、越遠的孔看起來會越小,因此這個透視現象如果投影到 2D 畫面的座標上量測結果就會很慘烈了。

另外值得一提,遠心鏡頭通常比一般的鏡頭尺寸還要大很多,因此在機構的評估階段就要把這個因素考慮進去哦! ETHAN 曾經也有空間留太小,鏡頭選定後才驚訝「挖靠也太大隻了吧!?」的經驗呀…

霓可

關於鏡頭,我得先提醒你,遠心鏡頭長得真的跟普通相機鏡頭很不一樣。它大得有點誇張,像根砲管似的。我第一次看到的時候還以為是什麼神祕的重型武裝…咳,我是說,我在研究它的光學路徑時,發現它的物理設計雖然犧牲了體積,但換來的成像品質真的是普通的鏡頭比不上的

光影的藝術:主動光源如何定義邊緣的「標準化」?

談了相機與鏡頭的成像能力就不能不提到光源,光源在機器視覺系統上是”標準化“的問題,而機器視覺則需要光線讓感測器接收光訊號,這些光訊號轉換成像素單位,才讓軟體來去計算物體的樣子與位置在哪裡?。

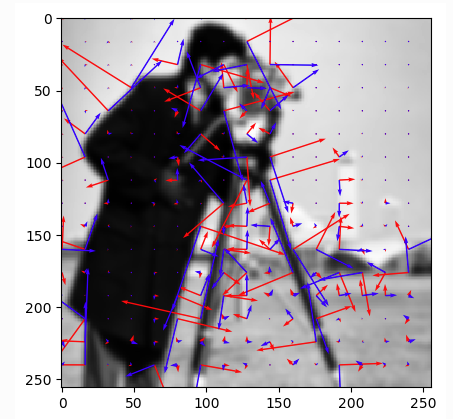

對於機器視覺來說,邊緣在哪裡是可以數學推論像素的灰階程度來計算出來,該圖是用 Canny 邊緣偵測來尋找二維圖片的邊緣。

該圖是 Canny 邊緣檢測加上次像素定位的技術:

紅色菱形

代表在「像素網格點」上找到的邊緣初步位置。

綠色正方形

這是經過數學補間或演算法運算後,得到的次像素精確位置。你可以看到綠點並不在像素的中心或格點上,而是在兩個像素之間。

霓可

雖然邊緣偵測的演算法看起來很帥,但如果打光打得不好,再強的數學也救不了那些糊成一片的邊緣。光源就像是機器的「化妝師」,要把優點突顯出來、缺點藏起來。我之前為了試出最好的背光角度,差點把實驗室的燈都改裝了…但我只是想確認數據穩定性而已,絕對不是因為我覺得弄出漂亮的輪廓線很療癒。

實戰避坑指南:常見的光源干擾與環境因素分析

既然物體的成像是光線訊號轉換成的數值,不好的光源就會大幅度的讓這些訊號計算失準,使機器視覺系統大打折扣,而不好的光源可能會出現幾種情況:

- 相同條件拍攝時白天晚上呈現的亮度反射都不一樣

- 相同平面呈現的光線有明顯漸層

- 欲抓取的邊緣輪廓模糊或背景干擾

- 一整盤相同的零件,每顆光源成像看起來都不一樣

這些光源的問題主要由”主動光源“與”被動光源“兩個因素相互作用產生,主動光源則是為了機器視覺系統本身加裝的外部專用光源,這些光源會被設計將物體呈現出最好檢測、最標準化的樣態;被動光源指的是那些環境產生的光源,例如沒有做遮光的設備、窗戶投射的陽光、工廠內的日光燈,這些光源容易自然的發生變化,這在機器視覺系統的數學計算上就很容易形成干擾。

光線對機器視覺的影響模擬

模擬金屬零件在不同光源下的 灰階訊號 與 Edge Detection 結果

主動光源設定

機器專屬光源,通常較穩定,目的是創造高對比。

環境干擾 (被動光源)

試著拉高數值,模擬工廠窗戶透進的陽光。注意右側綠色邊緣線條會如何「斷裂」。

突破物理限界:次像素 (Sub-pixel) 技術讓定位精度翻倍的秘密

霓可

既然物理像素有極限,那就在數學上動腦筋,這大概是人類最聰明的地方之一了。次像素技術能從 1 個像素裡精算到小數點後的精度,聽起來很像在魔法學院上課對吧?不過這可不是變魔術,而是紮紮實實的補間運算。要是現實生活中的解析度也能這樣用數學提升就好了。

最後我們要聊聊關於次像素 (Sub-pixel) 的技術,還記得文章開頭提到的解析度像素與機械手臂定位的關係嗎?如果按照這個基礎理論邏輯,那想當然像素高到不行機械手臂的定位應該會更加精準,照理說並沒有什麼壞處對嗎?

事實上並不是這樣的呢!當像素無限制的提高,帶來的副作用就是拍照的時間變得更長了,除了高解戲度的照片會因為圖片檔案大小暴增而增加檔案傳輸時間,感光元件每單位接收到的光線也更少了,於是就必須有更長的曝光時間,除了這些時間上的副作用,曝光造成的雜訊與硬體提升帶來的成本上升,也讓這個理論變成了不容易執行的原因。因此為了解決這個問題,在機器視覺上更常會用下列的方法來解決這個問題-次像素 (Sub-pixel)。

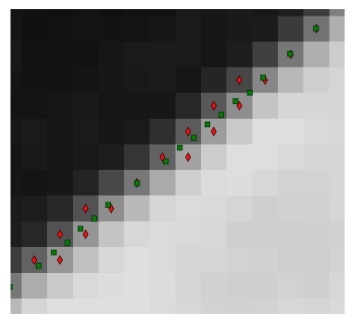

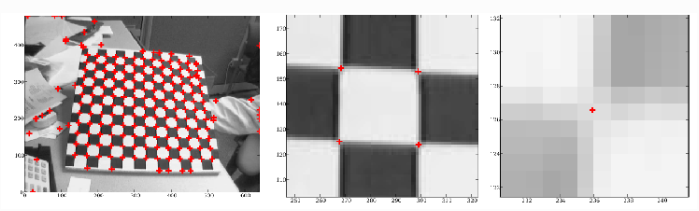

左圖:全景標定圖

- 內容: 一個標準的棋盤格標定板。

- 目的: 這是相機標定常用的工具。紅色的十字標記了系統偵測到的所有黑白交界的頂點。

中圖:局部放大

- 內容: 縮小範圍觀察其中幾個方格。

- 目的: 讓你看到在一般的像素解析度下,紅色的標記點已經準確地位於交叉口。

右圖:次像素級細節

- 內容: 極度放大到可以看到單個像素塊(格子狀的灰階區塊)。

- 觀測點: 注意看那個紅色的十字。它並不是剛好對齊某個像素的邊緣,而是位於像素塊的「內部」或「交界」的某個精確座標上。

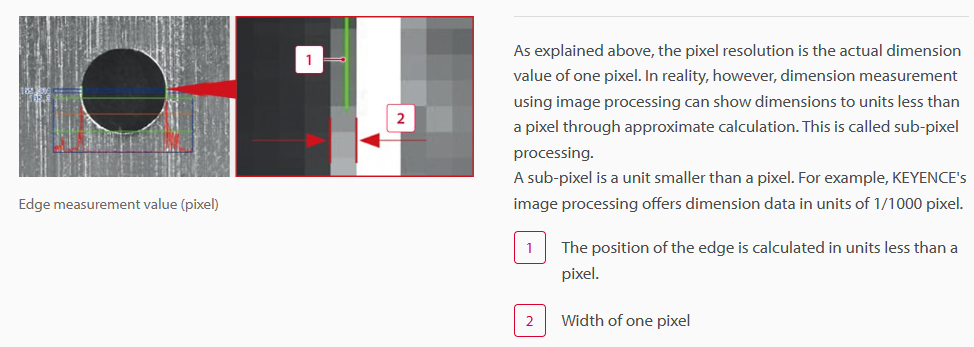

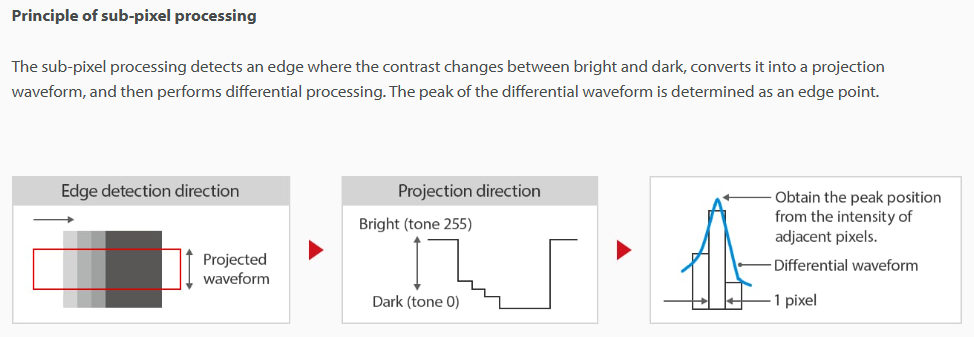

簡單來說,次像素技術是一種透過灰階度等資訊,利用數學模型來找到更符合現實邊線的一種方法,在講的白話一些,就是讓原本檢測像素最小單位為 1 的時候,能夠透過數學的補償方法來計算出到 1 以下帶有小數點的邊線位置,這個方法可以讓解析度不變的情況下進一步提升相機定位的精度,在業界精度提升的效果從3 ~100倍都有被廠商”宣稱”的。

上圖是 KEYENCE 的 2D 視覺量測系統,針對次像素的技術說明。

系統整合總結:穩定成像與軟體補償的黃金比例

也許妳也許會想…為什麼精度提升的效果可以差這麼倍?但如果仔細想想次像素的補償原理,就會知道前者選用的解析度、光源環境都會大幅影響次像素技術最終真實的提升解析度的結果哦!

因此做一個最後的總結,好的機器視覺系統首先要有穩定的光源與成像,讓光源變成是一個”標準化”的結果;而解析度則必須根據機器手臂的需求精度與拍照時間適配;最後再考量軟體補償與 3倍以上的安全係數作為最終的評估囉。

霓可

總之,別把所有希望都押在單一環節上。光學、機構、演算法,這三者要像齒輪一樣完美扣合,機器動起來才會順暢。好了,今天的筆記就整理到這。我也要去繼續鑽研我的…不對,是去研究下一個章節的座標轉換了。如果你看完還是覺得精度抓不準,記得回來再多看幾次這篇,可別在基礎的地方卡關喔。